清华大学陈建宇团队携手斯坦福ChelseaFinn团队,推出VLAW框架;世界模型与视觉-语言-动作策略实现协同迭代优化。

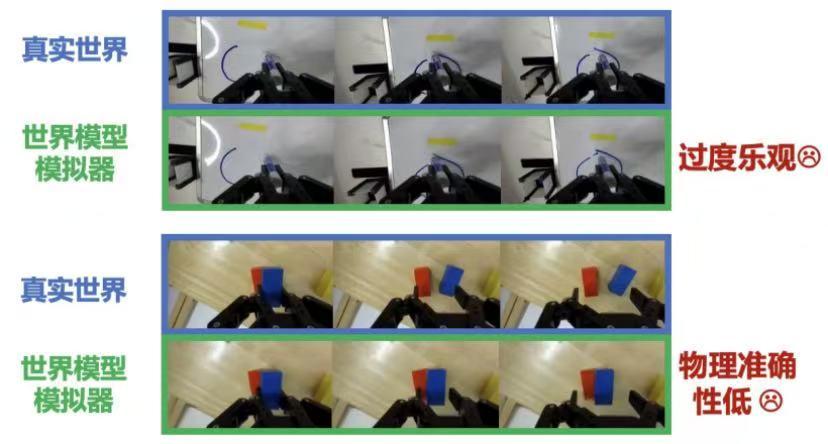

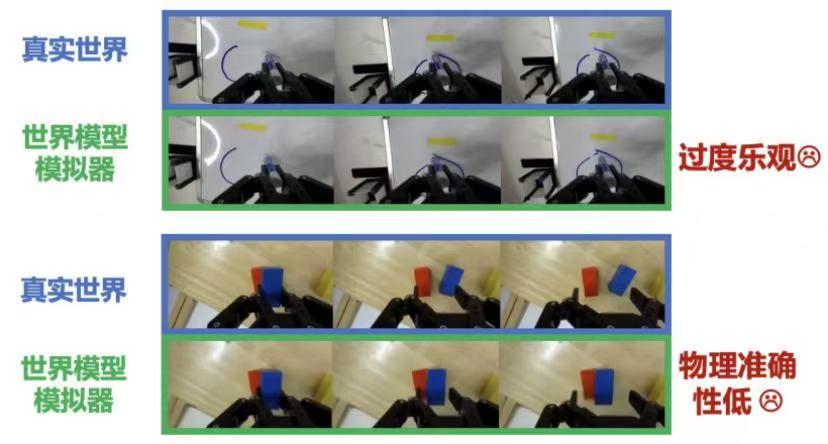

在具身智能研究领域,世界模型作为虚拟模拟环境的核心工具,一直备受关注。它允许机器人在无需消耗真实资源的情况下,进行大量试错训练,从而加速策略学习。然而,传统世界模型常常出现物理模拟偏差,以及对结果过于乐观的预测倾向。这些问题导致生成的虚拟交互数据质量不高,难以直接应用于提升机器人的实际操控能力。清华大学陈建宇教授领导的星动纪元团队,与斯坦福大学ChelseaFinn教授团队合作,针对这一痛点,共同开发出VLAW框架。该框架通过构建双向互动机制,让视觉-语言-动作策略(VLA)与世界模型互相促进、共同进步。

VLAW的核心在于形成一个持续优化的闭环系统。真实机器人通过执行当前策略,采集包含各种成功与失败案例的交互轨迹。这些宝贵数据被用于微调预训练的世界模型,帮助其修正物理规律的偏差,并缓解盲目乐观的预测习惯。经过校准的世界模型变得更加可靠,能够更真实地模拟复杂交互场景。随后,这个提升后的模型生成大量高质量合成轨迹。这些虚拟数据再被引入VLA策略的训练过程,进一步强化机器人的决策与动作能力。这种真实数据校准模型、模型数据反哺策略的循环方式,逐步打破了以往单向优化的局限性。

框架的具体实现流程清晰分为几个关键阶段。首先,部署当前VLA策略于真实机器人平台,收集少量在线轨迹数据,这些数据覆盖多样化的操作结果。接着,利用这些轨迹对世界模型进行针对性微调,提升其在物理交互方面的保真程度。优化后的世界模型与策略进行闭环互动,自动产生规模化的合成训练样本。同时,一个经过特别微调的视觉-语言奖励模型会对这些合成数据进行质量评估,确保只保留高价值部分。最后,将真实环境中的成功样本与筛选出的优质合成数据相结合,通过监督学习方式更新VLA策略。这一流程设计简洁高效,却能带来显著的性能增益。

实验验证了VLAW的有效性。研究选取了堆叠物体、舀取物料、表面擦拭等多种涉及复杂物理接触的任务类型。在这些任务中,经过VLAW迭代后的世界模型,其生成的视频序列在视觉真实感和物理一致性指标上均有明显改善。更重要的是,基于此类模型训练得到的机器人策略,在多项基准测试中的成功表现得到显著提升。进一步的消融分析显示,如果减少合成数据的比例,或者去除真实数据对模型的校准步骤,整体策略性能都会出现明显回落。这充分证明了框架中真实校准与虚拟生成两个环节的不可或缺性,以及它们之间协同作用的关键价值。

这一成果为具身智能的发展开辟了新路径。目前VLAW已在特定任务集上展现出良好潜力,未来研究可进一步探索如何扩展世界模型对更多样化场景的适应能力。同时,融入更前沿的视频生成技术,或许能让模拟环境变得更加丰富逼真。最终,这一方向有望推动世界模型真正成为机器人策略学习中实用且通用的基础设施。星动纪元与斯坦福团队的持续合作,也体现了跨机构联合攻关在推动前沿技术落地方面的积极意义。